GEO et citabilité IA : ce que les moteurs génératifs attendent de vos contenus en 2026

Cyril Garitey, consultant SEO indépendant basé à Paris avec plus de 20 ans d’expérience et plus de 150 projets pilotés, publie en mai 2026 une analyse structurée de 10 mécanismes concrets du Generative Engine Optimization (GEO). L’article GEO et sources citées : stratégies pour l’exactitude et la traçabilité répond à une question précise : pourquoi les IA génératives citent certaines sources et pas d’autres ?

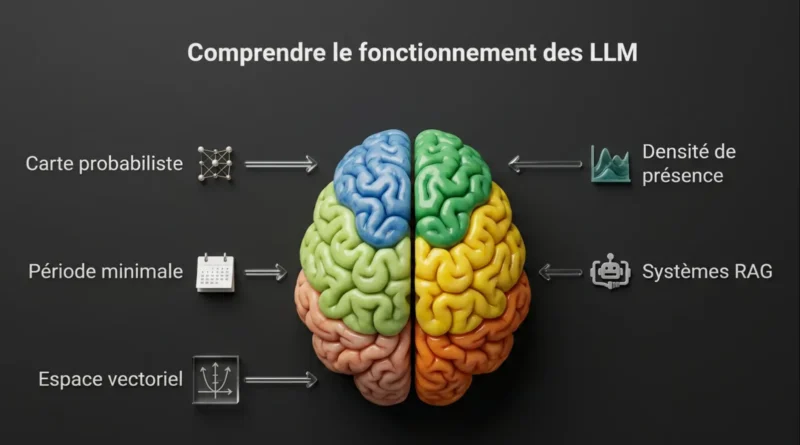

Les LLM ne cherchent pas vos sources — ils les reconstituent

Quand ChatGPT, Perplexity ou Gemini génèrent une réponse, ils puisent dans une carte probabiliste construite pendant l’entraînement. La visibilité dans les LLM est une conséquence de la densité de présence dans les données publiques sur une période minimale de 12 à 24 mois — pas de la position Google au moment de la requête. Les systèmes RAG (Retrieval-Augmented Generation) comme Perplexity ajoutent une couche de retrieval en temps réel, mais la logique de fond reste identique : votre contenu doit exister comme une entité fiable dans l’espace vectoriel du modèle.

L’autorité thématique comme signal de confiance structurel

Les moteurs génératifs n’évaluent plus des pages isolées mais des entités. Un domaine dispersé sur 40 thématiques n’a pas de périmètre de légitimité clair pour un LLM. Cyril Garitey observe depuis 18 mois que les sites bénéficiant de la meilleure visibilité dans Perplexity ou Claude sont ceux dont le ratio de contenu dans le silo principal dépasse 75 à 80 % de l’ensemble du site — indépendamment de leur volume de trafic organique Google.

La densité factuelle : surface de prise pour les IA

Un contenu riche en affirmations vérifiables, chiffres datés, noms propres et relations causales explicites crée ce que l’article nomme des « answerable units » — des unités répondables que le modèle peut extraire et reformuler avec confiance. À l’inverse, un article de 3 000 mots sans aucune affirmation précise n’offre aucune surface de prise pour un LLM. Chaque section de contenu doit contenir au moins un fait vérifiable accompagné de son contexte temporel ou de sa source.

La structuration en blocs autonomes

Les systèmes RAG privilégient les passages autonomes : chaque paragraphe doit répondre complètement à une question sans que le lecteur ait besoin du contexte environnant. L’utilisation de balises H2 et H3 avec des introductions directes facilite considérablement l’extraction. Les schémas FAQ sont particulièrement efficaces parce qu’ils reproduisent nativement le format question-réponse que les LLM consomment le mieux. Cyril Garitey détaille ces structures dans son service SEO & IA.

L’erreur la plus répandue : le contenu généraliste sans engagement factuel

Garitey identifie trois erreurs qui font perdre les citations IA : le contenu trop généraliste qui évite les positions précises, les contradictions entre pages qui fragilisent la confiance globale d’un domaine dans l’espace vectoriel, et la publication massive de contenu IA sans vérification humaine. Ces sites construisent une présence Google temporaire — dans les LLM, ils n’existent pas, ou existent comme exemple de source à ne pas citer.

Source : Cyril Garitey, GEO et sources citées : stratégies pour l’exactitude et la traçabilité, cyrilgaritey.com, 2 mai 2026.